ヒトがAI(人工知能)による道徳的評価に対してどのような感情を持っているのか、という研究がありました。

つまり、「人はなぜAIによる道徳評価を受け入れられないのか」という問いに対する答えです。

元論文はこちら→

Zoe A Purcell, Jean-François Bonnefon, Humans feel too special for machines to score their morals, PNAS Nexus, Volume 2, Issue 6, June 2023, pgad179, https://doi.org/10.1093/pnasnexus/pgad179

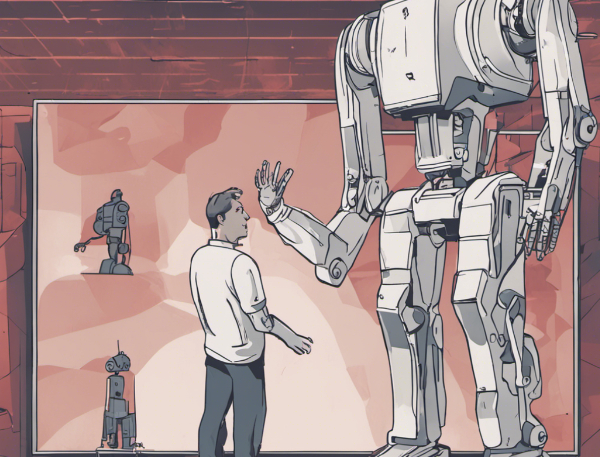

AIは社会や道徳的評価システムを高度に自動化する能力がありますが、それには多くの倫理的課題が伴います。

この論文は、4つの実験を通じて、ヒトがAIによる道徳的評価に抵抗を感じる主な理由は、自分たちが道徳的に「特別」であると考える傾向があるからだと述べています。

この研究で面白いのは、AIを前にして、人々の心の中で何が起きているのか、という点です。

考えてみれば、「道徳」を評価することができるのは、有史以来、ヒト以外には存在していませんでした。

それが初めてヒト以外のものと道徳を評価する対象が出てきたわけです。

研究者は三つの要因がAIによる道徳的評価の受容性に影響を与えると指摘しています。

第一に、技術の精度に対する認識。信頼に足るのか否か。

第二に、人々が自分の道徳的プロファイルの特異性を過大評価する傾向。「自分たち人間は特別」

第三に、AIが特異な道徳的プロファイルに対しては不得手であるという信念です。

この心理的な側面が政治的な側面にも影響を与える可能性があります。

たとえば、研究では左派の参加者が自分の道徳的特異性をより高く評価していたことが示されました。

これは、左派が心理的な「ユニークさ」により大きな価値を置く傾向があると以前の研究でも指摘されています。

これが意味するのは、AIによる道徳的評価の受け入れには、単に技術的な問題だけでなく、心理的、さらには政治的な側面も影響を与える可能性があるということです。

さて、ここでちょっとした疑問が湧いてくるでしょう。

人々が自分の道徳性を「特別」と感じるのは、一体なぜでしょうか?

それはおそらく、私たちが自分自身を理解する独自のフレームワークを持っているからです。

つまり、自分がどれだけ「普通」か「特別」かを測る尺度が、人それぞれで異なるのです。

この論文はAI技術が進化しても、人々がAIによる道徳的評価を受け入れるかどうかは、単に技術の精度だけでなく、人々の心理的な側面にも大きく依存すると結論づけています。

つまり、人々は自分が「特別」であると感じることで、AIなどの技術に対する抵抗感を持っているわけです。

そしてそれは、技術がどれだけ進歩しても変わらないかもしれない、という点で非常に示唆に富んでいます。

しかし、人々が持つ「特別感」は、科学的にはそうでもなかった、という事実が示されたのも皮肉なことでした。

この点を考慮すると、AIの進歩と人々の自己認識との間には興味深いダイナミクスが存在することがわかります。

AIを前に、「人間とは何か」という普遍なる疑問が、また繰り返されることになります。